「初探機器學習使用Python」まとめ#6 第五章 決策樹與隨機森林

「初探機器學習使用Python」(↓の中国語版 )

Thoughtful Machine Learning with Python: A Test-Driven Approach

- 作者: Matthew Kirk

- 出版社/メーカー: O'Reilly Media

- 発売日: 2017/01/27

- メディア: ペーパーバック

- この商品を含むブログを見る

前回↓

#6では第五章について扱う。

蘑菇的細微差別

本章は食用キノコと毒キノコの区別を例に話が進められる。

雖然人類善於處理資訊,卻可能做不出完美的客觀決策。人們的決定如同幻覺,死亡或美食一樣變化莫測,因而需要應用演算法來輔助進行決策;本章會使用決策樹的方式處理。

本章首先要討論蘑菇的細微差別以及論述模型運作成功的定義。其中會採用一種俗定理(folk-theorem)的做法將蘑菇分類,使用一些正常的分類技術來確定蘑菇是否包含有毒物質。並根據蘑菇的屬性將資料分類成群。另外會討論深層樹(deep tree)的不良影響。

還會討論尋查樹時所用的整體方法(ensemble method) - 隨機森林。本章會以試驗性焦點來說明如何處理蘑菇分類問題。(p69,70)

単語

- 雖然:〜だが

- 善於:〜が上手い

- 如同:〜と同じである,〜のようである

- 不出:しない

- 莫:〜しない,〜するな

- 輔助:手伝う

- 決策樹:decision tree,決定木

- 做法:方法

- 一些:いくつかの,少し

- 是否:〜かどうか

- 根據:〜による

- 另外:また

- 隨機森林:Random Forests,ランダムフォレスト

意訳

「人間は情報を扱うのが得意だが、完全に客観的な決定を下すことができないかもしれない。人々の決定は空想のようなものであり、死ぬか美味しく食べられるかが予測不可能なので、意思決定を助けるためにアルゴリズムを適用する必要がある;この章では決定木アプローチを使う。

この章では、まずきのこの区別について,そしてうまく動作するモデルの定義について説明する。その中で、きのこを分類するためにfolk-theoremの方法が使用され、きのこに有毒物質が含まれているかどうかを判断するためにいくつかの分類技法が使用される。ならびに,キノコの属性によってデータをグループに分類した。また,木を深くすることの悪影響について論じた。

また、木を探索するために使用されるアンサンブル方法ーランダムフォレストについても説明する。この章では、実験的なものに焦点を当ててきのこの分類方法について説明する。」

以俗定理將蘑菇分類

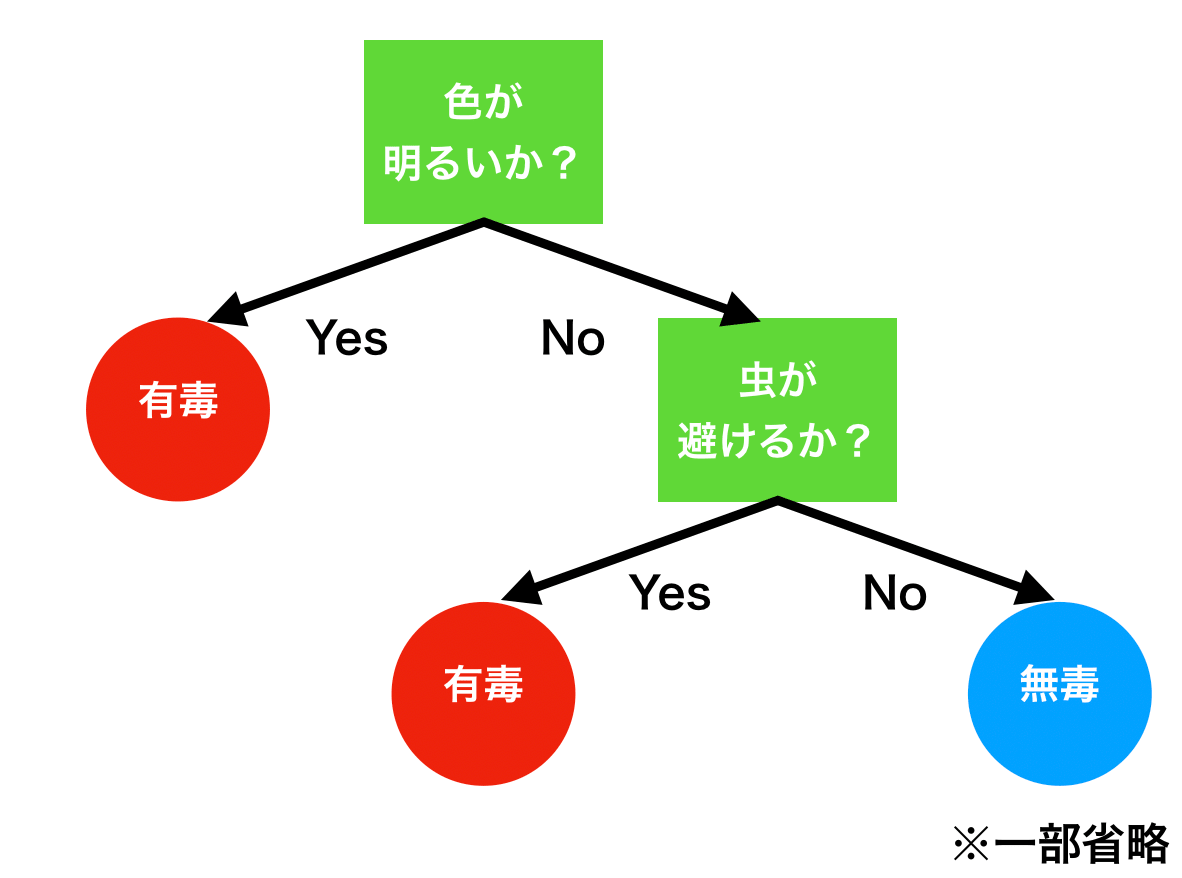

本書でいう民俗学の伝統的な区分を下に示した(一部抜粋)。

信頼できるかは置いといて,この図は決定木の構成そのものである。

尋找最佳交換點

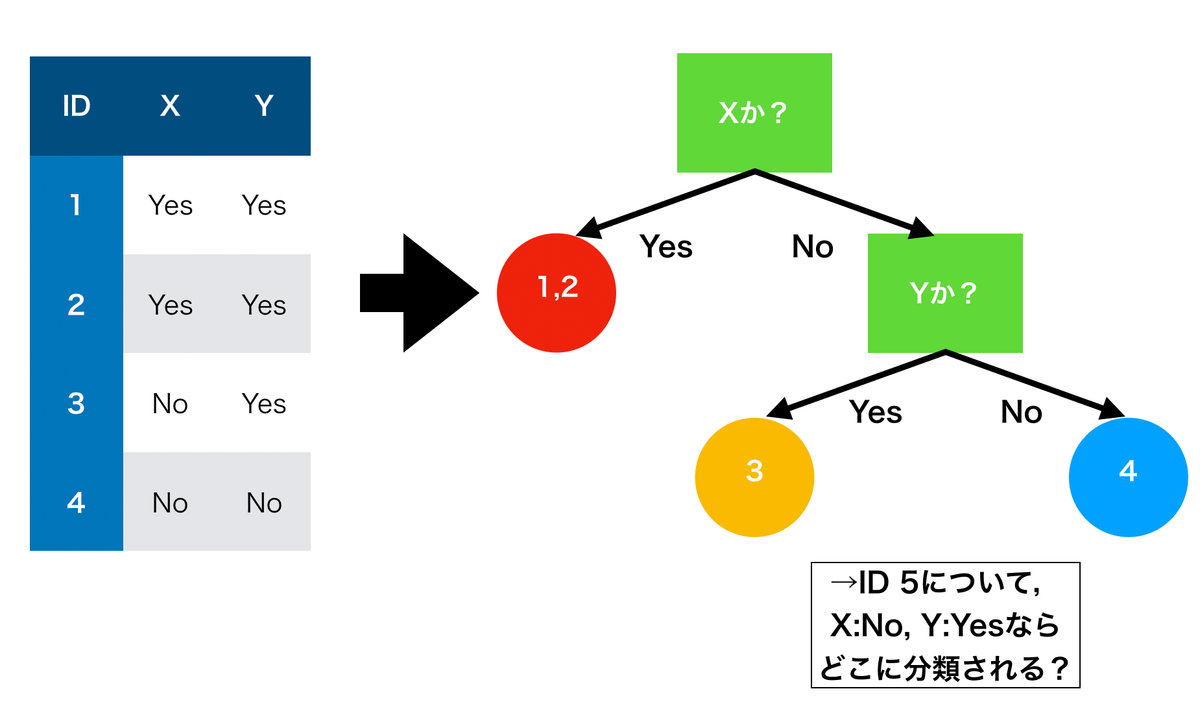

ここで民俗学にしたがうのでなく,データベースをもとに木を作ることを考える。

細分化に用いるパラメータは,主に以下の3つである。

- 資訊增益(Information gain)

- 吉尼不純度(GINI impurity)

- 變異數縮減(Variance reduction)

詳細についての参考記事:https://qiita.com/3000manJPY/items/ef7495960f472ec14377

修剪樹

機械学習における過学習を防ぐために,木の枝を途中で剪定して単純なものにする。

整體學習

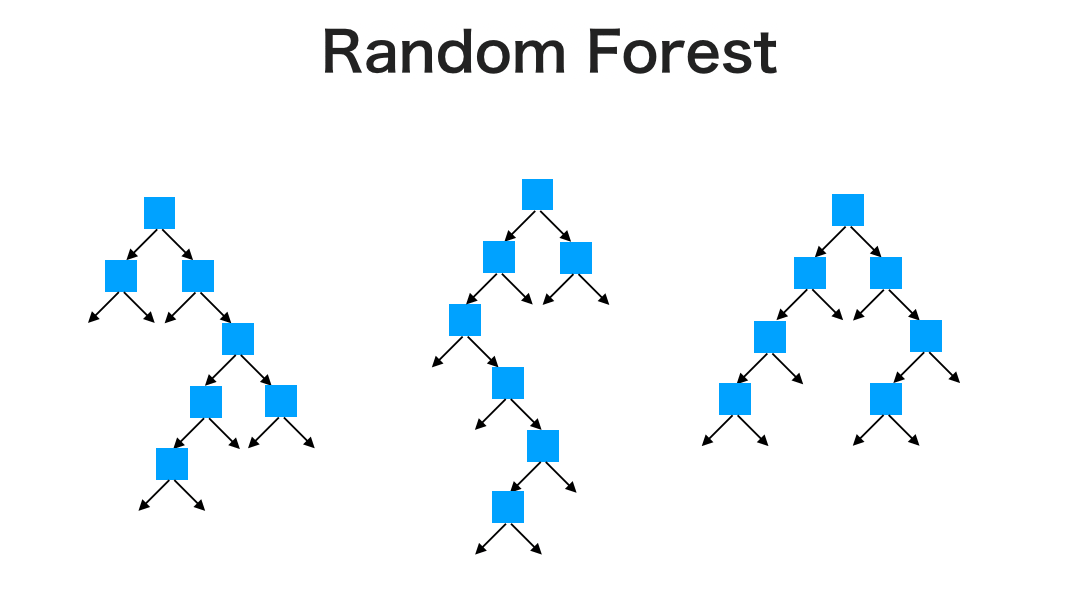

整體學習(Ensemble Learning) は複数の学習器をそれぞれ学習させて融合する手法である。本書ではBaggingと隨機森林について説明される。

Bagging

整體學習的一種簡單做法是bagging,這是「bootstrap aggregation」(自助聚合法)的簡寫。創立這個方法的目的是改善模型而不會改變除了訓練集之外的一切,主要是聚合多個隨機版本的訓練集來達成目的。(p76)

単語

- 簡寫:省略形,簡略化したもの

- 除了 X 之外:X以外

- 聚合:集合する

- 版本:バージョン

意訳

「アンサンブル学習の簡単な方法はbaggingであり,これは「bootstrap aggregation」の省略形である。この方法を作成する目的は、主に目的を達成するためにトレーニングセットの複数のランダムバージョンを集約することによって、トレーニングセット以外のすべてを変更せずにモデルを改善することである。 」

隨機森林

特徴量をランダムに選択して複数の木を作成する手法である。

本章總結

本章學習如何使用決策樹將資料分類。這可適用於層次分類與某些屬性可妥善確定劃分點的時機。另外呈現出決策樹與隨機森林兩者都非常適合對蘑菇的可食性進行分類。最後切記 - 不要在野外使用這個分類器將蘑菇分類!找一位真菌學家來處理會比較保險。(p86)

単語

- 妥善:適切である

- 劃分:区分する

- 切記:記憶する,覚えておく

- 保險:保証する,安全である

意訳

「この章では、どのように決定木を使用してデータを分類するかについて学習した。これは階層的な分類や特定の属性が分割点を適切に決定できる場合に適用できる。さらに、決定木とランダムフォレストの両方が、きのこの食味を分類するのに非常に適している。最後に、きのこを分類するためにこの分類器を野生で使用しないことを忘れないこと!真菌学者を見つけることでより安全に対処するだろう。」

次回↓